¿Qué es Googlebot, Bingbot y los robots en general?

Antes de explicar como funcionan los buscadores de manera simplificada les hago esta pregunta:

¿Nunca pensaron qué es lo que sucede cuando uno hace una búsqueda en Google? Me refiero a cual es el proceso por el cual aparecen los resultados que aparecen y se ordenan de la manera que se ordenan.

Veamos si podemos explicarlo de manera sencilla. Básicamente todos los motores de búsqueda tienen un «robot» (no de ojalata ni de metal) que no es más que un proceso que navega la web como lo hacemos nosotros todos los días. Ok, en realidad no lo hace de la misma manera, pero pensemos por un momento que es así. Este proceso navega las páginas web escaneando su contenido, identificando palabras claves, analizando los links que cada página recibe tanto del mismo sitio o de sitios externos y lo que hace es llevarse una copia de esa página. Esa copia de cada página web es enviada a los servidores de Google que procesan la información que este proceso o robot le va entregando a medida que sigue navegando por internet.

Este proceso o robot tiene un nombre específico para cada buscador. El robot de Google se llama Googlebot. El de MSN se llamaba MSNBot pero a partir de Octubre del 2010 lo reemplazaron con uno más nuevo llamado Bingbot ya que Microsoft hizo un relanzamiento de su buscador llamado Bing.

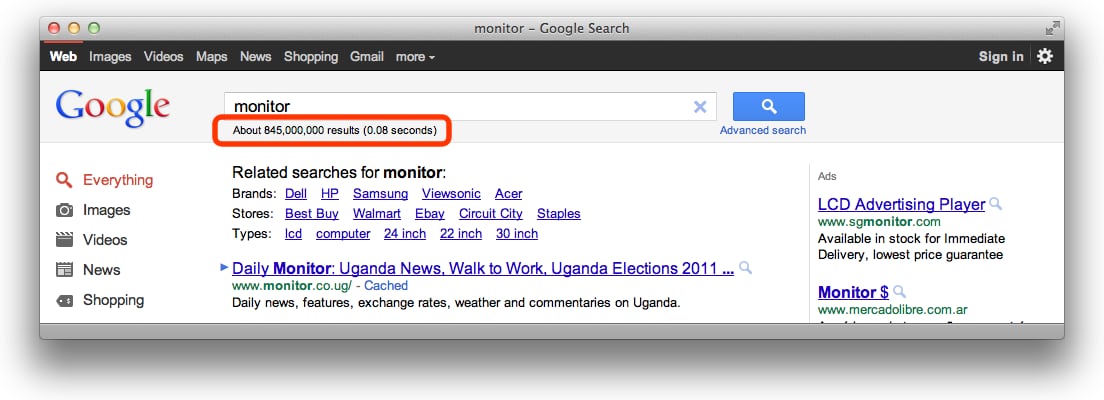

De esta manera los motores de búsqueda se hacen de una copia de cada página web que sus respectivos robots van encontrando. Estas copias forman parte luego de un índice, de ahí el término páginas indexadas, osea páginas que forman parte de un índice. Es similar a aparecer en las Páginas Amarillas, sólo que el proceso es bastante diferente. Cuando uno se anuncia en las Páginas Amarillas aparece en un índice ordenado alfabéticamente. En el caso de los motores de búsqueda uno aparece ordenado mediante un algoritmo mucho más complejo que contempla varios factores para rankear las páginas en sus resultados de búsqueda o SERP´s ante la búsqueda de una palabra clave.

Sin estos «robots», los motores de búsqueda no podrían mostrar resultados ante una búsqueda. Cuando uno hace una búsqueda en Google no es que Google sale a buscar en ese momento que sitios responden a la palabra clave que uno puso en la caja de búsqueda. Si fuese así, tardaría siglos en mostrar los resultados porque tendría que salir a buscar bajo demanda en que sitios hay algo que responda a lo que estemos buscando. Pero al tener copias de millones y millones de páginas que el robot previamente le fué entregando es más fácil presentar resultados. Incluso tarda menos de un segundo en hacerlo.

Esto lleva a plantearnos varias cuestiones relacionadas al SEO. Si el robot no puede acceder a tú página web o no puede interpretar correctamente su información eso se verá reflejado en los resultados de búsqueda. Si no puede acceder a tu página entonces sería como no existir en los resultados de búsqueda porque no hay páginas de tu sitio que Google haya podido procesar para mostrar ante una palabra clave relacionada.

Si puede acceder pero no puede interpretar correctamente su información eso se verá reflejado mediante un pobre posicionamiento y por ende pérdida de oportunidad de generar negocios.

Este proceso de recopilación de datos plantea uno de los principales pilares que siempre presento, y es el de la Accesibilidad de la información (por parte de los buscadores).

Resumiendo, los robots son procesos que cada buscador (Google, Bing, etc) tiene para recopilar cada página web de cada sitio para luego procesar y mostrar como resultado de búsqueda.

¿Cómo ver la actividad de los robots en nuestro sitio web?

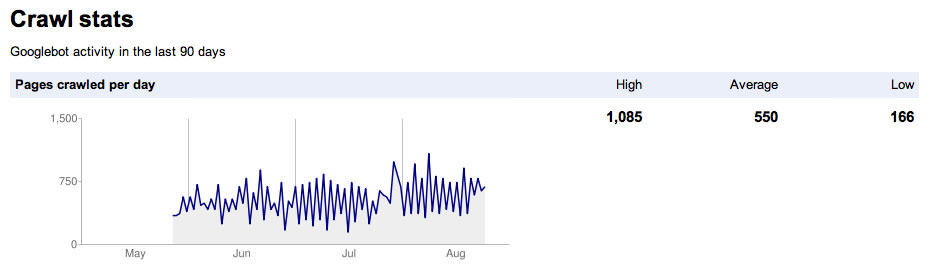

Google tiene una herramienta online llamada Google Webmaster Tools en la cual nos permite ver dentro de Diagnósticos > Estadísticas de Rastreo la actividad que tuvo Googlebot en nuestro sitio, mostrándonos desde la cantidad de páginas que navegó el robot por día, los kilobytes descargados por día y el tiempo de descarga de una página por día.

Bing también tiene una herramienta similar para Webmasters en la cual muestra la actividad del robot Bingbot en nuestro sitio. La misma está en la solapa Crawl

¿Cada cuanto ingresan los robots a mis sitios?

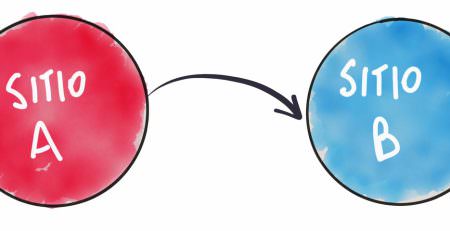

Depende de varios factores. Uno de ellos es de la cantidad de enlaces o links que tenga tu sitio web desde otros sitios. Mientras más enlaces hayan desde otros sitios apuntando a tu sitio web, mayores serán las chances de que estos robots accedan a tu sitio ya que tienen más formas de llegar al mismo.

¿Puedo forzar a un robot a que ingrese a mi sitio?

Respuesta rápida: NO

Respuesta larga: No, no se puede. Este proceso es automático. Muchos sitios utilizan una metaetiqueta <meta name=»revisit-after» content=»15 days»> que no sirve para nada. No se puede obligar a los robots a que ingresen a tu sitio web.

Y recuerden que si quieren hacer un trabajo de SEO, no tienen más que hacer que consultar 🙂

Comments (3)

Gracias por la información, estaba buscando algo sobre el «revisit-after», parece que la opinion generalizada es que no sirve de nada o no es efectivo.

Un saludo

[…] refiere a hacer que la información y contenido de nuestras páginas se vuelvan accesibles para los robots para que puedan ser indexados y que se empiecen a mostrar en las páginas de resultados de […]

[…] en Google es con un link en una página que Google ya está crawleando. Al entrar en esa página, Googlebot va a ver el enlace que apunta a tu sitio, va a entrar y lo va a crawlear. Este segundo método […]